■ 최근 LLM은 복잡한 multi-step reasoning을 수행하는 능력이 크게 향상되었으나, 여전히 SOTA models에서 logical mistakes을 일으킨다.

■ 더 신뢰할 수 있는 모델을 학습시키기 위해, final result에 feedback을 제공하는 "outcome supervision"이나 각 중간 reasoning step에 대해 feedback을 제공하는 "process supervision"을 사용할 수 있다.

- outcome supervision: model의 final result에 feedback을 주는 방식

- process supervision: reasoning의 각 중간 단계마다 feedback을 주는 방식

■ 신뢰할 수 있는 모델 학습의 중요성과 human feedback의 높은 비용을 고려할 때, 두 가지 supervision 방식 중 어느 것이 더 효과적인지 비교할 필요가 있다.

■ 저자들이 자체 조사한 결과, challenging한 MATH dataset의 문제를 해결하도록 모델을 학습시키는 데 있어 process supervision이 outcome supervision보다 성능이 월등히 뛰어나다는 것을 발견했다.

■ 논문에서는, 저자들이 만든 process-supervised model이 MATH test set의 representative subset에서 문제의 78%를 해결하고, active learning이 process supervisio의 효율성을 크게 향상시킨다는 것을 보여준다.

■ 그리고 관련 연구를 위해, reward model을 학습시키는 데 사용된 800K 개의 step-level human feedback labels이 포함된 PRM800K dataset을 공개한다.

[2305.20050] Let's Verify Step by Step

Let's Verify Step by Step

In recent years, large language models have greatly improved in their ability to perform complex multi-step reasoning. However, even state-of-the-art models still regularly produce logical mistakes. To train more reliable models, we can turn either to outc

arxiv.org

1. Introduction

■ LLM은 step-by-step chain-of-thought format으로 solutions을 생성함으로써 복잡한 multi-step reasoning이 필요한 tasks을 해결할 수 있다.

■ 그러나 이 접근법은 SOTA models에 적용하더라도 거짓 정보를 생성하게 하며, 불확실한 순간에 사실을 지어내는 한계가 여전히 존재한다.

■ 이러한 hallucinations은 multi-step reasoning이 필요한 영역에서 특히 문제가 되는데, 단 하나의 논리적 오류만으로도 전체 solution을 망칠 수 있기 때문이다.

■ 그래서 모델의 reasoning capabilities을 향상시키기 위해 hallucinations을 완화해야 하는 것은 필수이다.

■ "hallucinations을 완화시키는 효과적인 한 가지 방법"은, 바람직한 outputs과 바람직하지 않은 outputs을 구별하도록 "reward model을 학습시키는 것"이다.

■ reward model은 reinforcement learning pipeline에서 사용되거나, rejection sampling을 통한 탐색을 수행하는 데 사용될 수 있다.

■ 이런 테크닉들이 유용하기는 하지만, 결과의 신뢰성은 전적으로 reward model 자체의 신뢰성에 달려 있다. 그러므로, 신뢰할 수 있는 reward model을 가장 효과적으로 학습시키는 방법을 찾는 것이 중요하다.

■ 이 주제의 선행 연구에서는 reward model을 학습시키는 두 가지 방법인 "outcome supervision"과 "process supervision"을 제안했다.

- 선행 연구: Solving math word problems with process-and outcome-based feedback

■ outcome-supervised reward model (ORM)은 모델의 chain-of-thought의 최종 결과만을 통해 학습되는 반면, process-supervised reward model (PRM)은 chain-of-thought 내의 각 step에 대한 feedback을 받는다.

■ 두 방법 중 process supervision이 선호되는 이유는, (1) 오류가 발생한 정확한 위치를 명시하기 때문에 더 정밀한 feedback을 제공할 수 있기 때문이다.

■ 또한, (2) AI alignment와 관련하여 몇 가지 장점이 있다: 인간이 해석하기 더 쉽고, 인간이 선호하는 chain-of-thought을 따르도록 모델을 직접적으로 학습시킬 수 있다.

■ logical reasoning 영역에서, outcome supervision으로 학습된 모델들은 incorrect한 reasoning을 사용했음에도 불구하고, 올바른 final answer로 도달하는 경우가 빈번하지만, 선행 연구에서는 process supervision은 이러한 misaligned된 behavior를 완화하는 것으로 나타났다.

■ 이러한 장점들에도 불구하고, 선행 연구에서는 초등학교 수준의 math(GSM8K)에서 outcome supervision과 process supervision이 비슷한 최종 성능을 보인다고 reporting했다.

■ 이 논문에서는 선행 연구와 세 가지 주요 차이점을 두고 process supervision에 대한 비교를 수행한다: (1) 더 유능한 base model을 사용하고 (2) 훨씬 더 많은 양의 human feedback을 사용하며, 더 challenging한 MATH dataset에서 학습과 테스트를 진행한다.

2. Methods

■ 논문에서는 선행 연구와 비슷한 방법론을 따르며, outcome supervision과 process supervision의 비교 실험을 수행한다.

■ MATH dataset의 모든 문제는 automatically하게 확인할 수 있는 answers을 가지고 있기 때문에, outcome supervision은 human의 개입 없이도 자동화할 수 있다. 반면, process supervision은 자동화하는 간단한 방법이 없다.

■ 그래서 저자들은 human data-labelers에게 의존하여 process supervision을 진행했으며, human labelers에게 모델이 생성한 solutions의 각 step에 대한 정답 여부를 라벨링하도록 하였다.

■ large-scale과 small-scale라는 두 가지 별도의 regimes에서 실험을 수행한다. 각각은 고유한 장점이 있으며, 상호 보완적인 관점을 제공한다.

■ large-scale 실험에서는 모든 모델을 GPT-4로부터 finetune한다. 가능한 가장 신뢰할 수 있는 ORM과 PRM을 학습시켜 SOTA를 발전시키는 데 중점을 둔다.

■ 단, large-scale 실험에서 reward models의 training sets은 구성 방식의 차이로 인해 직접적인 비교가 불가능하다. 그래서 이 모델들은 outcome supervision과 process supervision을 1:1로 비교하는 데 이상적이지 않다.

■ 이 문제를 해결하기 위해, small-scale에서도 모델을 학습시켜 더 직접적인 비교를 수행한다. 단, 비용이 많이 드는 human feedback을 사용하지 않고, large-scale model을 labeler로 사용한다.

2.1 Scope

■ 각 model scale에서 모든 solutions을 생성하는 데 하나의 fixed modeld을 사용한다. 이 fixed model을 논문에서는 generator라고 부른다.

- reinforcement learning (RL)을 통해 generator의 성능을 개선시키지 않았다.

- generator를 고정시킴으로써, 오직 reward model 학습 방법의 효과만 분리해서 측정할 수 있다.

- 만약, generator도 함께 학습시킨다면, 성능 향상이 reward model인지 generator 때문인지 구별하기 어렵다.

■ outcome 및 process supervision을 얘기할 때, 이는 구체적으로 reward model에 주어지는 supervision을 의미한다.

■ RL로 학습될 경우 generator가 reward model로부터 받게 될 supervision에 대해서는 논문에서 논하지 않는다. RL을 사용하여 generator를 fine-tuning하는 것이 자연스러운 단계이긴 하지만, 의도적으로 이 논문에서는 배제되었다.

- 논문의 초점은 ORM과 PRM 중 어떤 것이 더 좋은가이다.

■ 대신, 가장 신뢰할 수 있는 reward model을 학습시키는 방법에만 중점을 둔다.

■ generator에서 균등하게 샘플링된 solutions에 대해 best-of-N search를 수행하는 능력으로 reward model을 평가한다.

■ 각 test problem에 대해 reward model이 가장 높게 평가한 solution을 선택하고, final answer를 기준으로 자동으로 채점하여 정답 비율을 reporting한다. 더 신뢰할 수 있는 reward model일수록 correct solution을 더 자주 선택할 것이다.

- 즉, generator가 만든 N개의 solutions 중 reward model이 1등으로 선택한 solution이 실제 정답인지 아닌지로 reward model을 평가한다.

2.2 Base Models

■ 모든 large-scale models은 GPT-4 model로부터 finetuned된다. 이 GPT-4는 base model이다. 즉, 오직 next token을 예측하도록 pretrained되었으며, human feedback을 통한 RLHF가 적용되지 않았다.

■ small-scale base models은 설계상 GPT-4와 비슷하지만, 약 200배 더 적은 연산량으로 pretrained되었다.

■ 추가적인 pretraining step으로 'MathMix'라고 부르는 약 1.5B 개의 high-quality의 math-relevant tokens로 구성된 dataset으로 모든 모델을 finetune시켜 모델의 mathematical reasoning capabilities을 향상시킨다.

2.3 Generator

■ reasoning 과정의 각 step을 더 쉽게 파싱하기 위해, generator가 줄바꿈으로 구분된 step-by-step 형식으로 solutions을 생성하도록 학습시킨다.

■ 구체적으로, MATH training problems에 대해 few-shot으로 solutions을 생성하고 올바른 final answer에 도달한 것들을 필터링한 뒤, 이 dataset으로 base model을 1 epoch 동안 finetune한다.

■ 이 단계는 generator에게 어떤 새로운 skills을 가르치기 위함이 아니며, 오직 generator가 저자들이 원하는 format으로 solutions을 생성하도록 가르치기 위한 것이다.

2.4 Data Collection

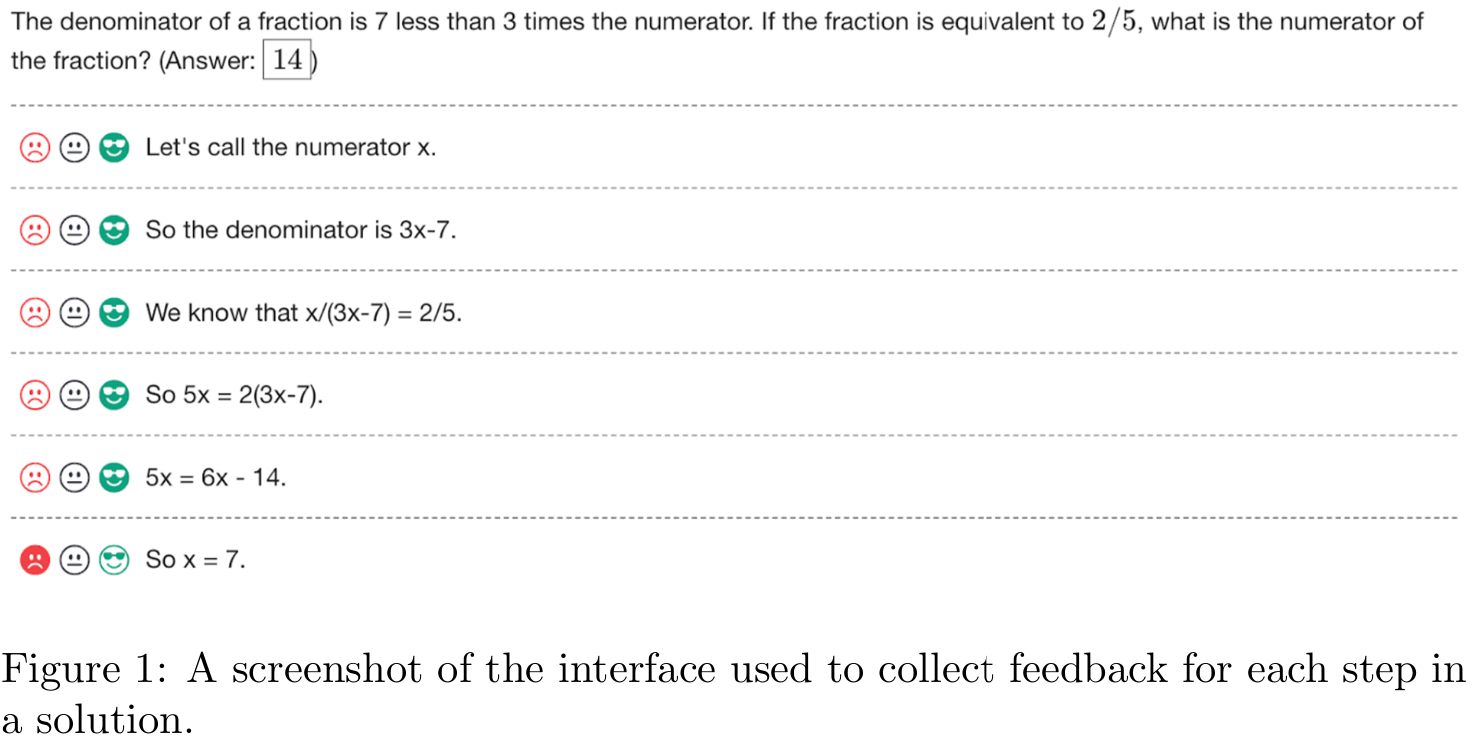

■ process supervision data를 수집하기 위해, human data-labelers에게 large-scale generator에서 샘플링된 MATH problems에 대한 step-by-step solutions이 제시되면, human labelers은 Fig 1처럼 solution의 각 step에 positive, negative, neutral label을 할당한다.

■ positive label은 해당 step이 정확하고 합리적임을, negative label은 해당 step이 부정확하거나 비합리적임을 의미한다. neutral label은 ambiguity를 의미한다.

■ 미묘하게 오해를 불러일으키거나, 틀린 말은 아니지만 좋지 않은 제안일 경우 neutral로 라벨링될 수 있다. 테스트 시점에서는 neutral label을 positive나 negative 중 하나로 취급할 수 있다. (Appendix D)

■ 전적으로 large-scale generator에서 나온 solutions만을 라벨링한다. 수집된 step-level labels의 전체 데이터셋을 PRM800K라고 부르며, PRM800K의 training set에는 12K 개의 problems에 대한 75K 개의 solutions에 걸쳐 800K 개의 step-level labels이 포함되어 있다.

■ overfitting을 최소화하기 위해, 4.5K 개의 MATH test problems을 PRM800K training set에 포함시켰다. 그래서 저자들은 남은 500개의 MATH test problems에 대해서만 모델을 평가한다.

■ 데이터 수집 중에 어떤 solutions을 data-labelers에게 보여줄지 결정해야 한다. 가장 간단한 방법은 generator가 만든 solutions을 균등하게 보여주는 것이다. 그러나 이 방법은 명백한 오류가 있는(너무 뻔한 실수가 포함되) solution을 보여준다면, 얻게 되는 human feedback의 가치는 떨어진다.

■ 저자들은 best reward model을 속일 가능성이 높은 solutions을 labelers에게 주고자 하였다. 구체적으로, "convincing wrong-answer" solutions을 labelers에게 보여준다.

- 이는 best reward model이 좋은 solution이라고 판단한 것(틀렸는데 맞다고 착각함)과 실제 정답 여부 사이의 괴리를 명확히 학습시키기 위함이며, 이러한 괴리가 발생하는 solution일수록 human이 세밀하게 피드백해 줄 가치가 높기 때문이다.

- 간단히 말하면, 이런 유형이 학습 가치가 더 높다.

■ 논문에서는 best PRM에 의해 높은 점수를 받은 solutions을 "convincing"이라고 부르며, 잘못된 final answer에 도달한 solutions을 "wrong-answer"라고 부른다.

- 정답 여부는 오직 final answer 확인을 통해서만 이루어진다.

■ 이렇게 convincing wrong-answer solutions을 labeling함으로써 더 많은 정보를 얻을 수 있다. 왜냐하면 PRM이 해당 solution에서 적어도 한 단계에 대해서는 잘못 판단하고 있기 때문이다.

■ 이러한 selection strategy를 사용하는 것에 더해, 데이터 수집 과정의 여러 시점에서 최신 데이터를 사용하여 PRM을 반복적으로 re-train시켰다.

■ re-train에서 각 iteration마다 problem당 N개의 solutions을 생성하고, top K개의 가장 convincing wrong-answer solutions만을 data-labelers에게 보여준다.

- 데이터를 수집하고, PRM을 re-training하고, 다시 더 어려운 오답(convincing wrong-answer solutions)을 찾아내는 과정을 반복한 것

2.5 Outcome-supervised Reward Models (ORMs)

■ ORM의 경우, 이전 연구를 따라 generator에서 problem당 고정된 수의 solutions을 균등하게 샘플링하고, 각 solution이 맞는지 틀린지를 예측하도록 ORM을 학습시킨다. (Appendix E)

■ 보통 final answer를 자동으로 확인하여 정답 여부를 결정하지만, 원칙적으로는 이 labels을 human이 제공할 수도 있다.

■ test time에서는 final token에 대한 ORM의 예측값을 해당 solution의 score로 사용한다.

■ ORM의 targets을 결정하는 데 사용되는 자동 채점이 완벽하게 신뢰할 수 있는 것은 아니다. 왜냐하면 잘못된 reasoning을 사용했음에도 불구하고 올바른 answer에 도달하는, 즉 잘못 채점된 false positive인 경우가 있기 때문이다.

2.6 Process-supervised Reward Models (PRMs)

■ 각 step이 끝난 지점(last token)에서 해당 step이 correctness한지 예측하도록 PRM을 학습시킨다.

■ 이 예측 결과는 correctness한지를 나타내는 single token 형태이며, training 과정에서 이러한 target tokens의 log-likelihood를 최대화하도록 학습시켰다.

■ 이렇게 PRM은 마치 언어 모델처럼 학습된다. 즉, 특별한 조정 없이도 standard language model pipeline에서 학습시킬 수 있다.

■ test time에서 step-level predictions을 결정하기 위해서는 전체 solution에 대해 단 한 번의 PRM forward pass만 수행하면 충분하다. solution 전체를 한 번만 forward pass하면 모든 step의 점수를 얻을 수 있기 때문이다.

■ Fig 2는 동일한 문제에 대한 서로 다른 두 가지 solutions이며, 이를 large-scale PRM이 채점한 scores을 시각화한 것이다.

- 왼쪽 솔루션은 정답이고, 오른쪽 솔루션은 오답이다. 녹색 배경은 높은 PRM score를, 빨간색 배경은 낮은 PRM score를 나타낸다.

■ 여러 개의 solutions을 비교하기 위해서는, 각 solution에 대한 single score를 계산해야 한다.

■ 저자들은 하나의 solution에 대한 PRM score를 "PRM 하에서 모든 step이 정확할 확률"로 정의한다. 이는 각 step의 정답 확률들의 곱으로 구현할 수 있다. (다른 점수 산정 방식들은 Appendix F)

■ 실제로 정답인 solutions에 대해서는 두 방법(outcome supervision, process supervision) 모두 모든 step이 옳다는 정보는 제공한다.

■ 그리고 오답인 solutions에 대해서는 두 방법 모두 하나의 오류가 존재한다는 사실을 알 수는 있지만, process supervision은 그 오류의 정확한 위치를 알 수 있다.

■ 만약, 첫 번째 오류 이후의 steps에 대해서도 추가적인 process supervision을 한다면, process supervision은 훨씬 더 큰 정보 우위를 갖게 된다. 그럼에도 불구하고 저자들은 공정한 비교를 위해 이를 제한했다.

- 즉, outcome supervision과 process supervision의 공정한 비교를 위해 첫 번째 오류까지만 사용하고, 그 뒤의 오류들은 사용하지 않는다.

- (1) 정보 우위를 배제하고 방법론 자체의 우수성을 비교하기 위한 설계이다.

- 또한, 이렇게 함으로써 (2) human labelling cost를 비슷하게 유지할 수 있다. 이 solutions이 맞나를 검증하는 것은 결국 첫 번째 오류가 어디인지 찾는 과정과 노동력이 같다.

- 첫 번째 오류가 있으면 그 뒤의 오류들은 볼 필요 없이 해당 solution이 틀렸다는 판정을 내릴 수 있기 때문이다.

3. Large-scale Supervision

■ PRM800K의 step-level labels을 사용하여 large-scale PRM을 학습시킨다. 그리고 large-scale ORM baseline을 최대한 강력하게 만들기 위해, generator에서 problem당 100개의 uniform samples을 추출하여 학습시킨다.

■ 물론 이 두 training sets을 직접적으로 비교할 수는 없지만, ORM training set이 PRM800K와 겹치지 않으며, 그 규모가 10배 더 크다.

- 저자들의 목표는 각 방법론으로 달성할 수 있는 SOTA를 확인하는 것. 따라서 ORM에게는 ORM에 유리한 데이터를, PRM에게는 PRM에 유리한 데이털를 사용.

■ PRM800K solutions만으로 ORM을 학습시키는 것은 문제가 있다. 왜냐하면 PRM을 위해 데이터셋을 wrong-answer solutions 쪽으로 심하게 편향시켰기 때문이다. (섹션 2.4)

■ ORM은 정답/오답의 균형만 필요하다.

■ 저자들은 균등하게 샘플링된 solutions을 섞어 PRM800K solutions의 superset으로 ORM을 학습시켰으나, ORM의 성능을 향상시키지 못했다고 한다.

■ Fig 3은 각 reward model의 best-of-N 성능이 N의 함수로서 어떻게 변하는지를 보여준다.

- majority voting(예: self-consistency)은 strong baseline으로 알려져 있다. 그래서 이 방법 또한 비교 대상에 포함한다.

■ ORM이 majority voting보다 약간 더 나은 성능을 보이며, PRM은 둘 모두 앞서는 것을 볼 수 있다.

■ PRM은 모든 N값에 대해 더 높은 성능을 기록할 뿐만 아니라, N이 증가함에 따라 성능 격차가 벌어진다. 이는 PRM이 대량의 model-generated solutions을 탐색하는 데 있어 ORM과 majority voting보다 더 효과적임을 보여주는 결과이다.

4. Small-scale Synthetic Supervision

■ large-scale에서 PRM이 ORM보다 성능이 뛰어나다는 것은 확인했지만, 이 결과만으로는 부족하다. outcome supervision과 process supervision을 더 잘 비교하기 위해서는 반드시 분리해야 할 두 가지 confounding factors이 있다.

■ 첫 번째는 ORM과 PRM의 training sets을 직접 비교할 수 없다는 것이다. PRM training set은 active learning을 사용하여 구축되었고, answer-incorrect solutions에 편향되어 있으며, 그 크기가 10배 정도 더 작기 때문이다.

■ 두 번째는 final-answer 채점 방식이 잘못된 reasoning에도 불구하고 올바른 final answer에 도달하는 거짓된 solutions에도 positive labels을 부여하는 것이다.

■ 이는 결과적으로 ORM의 성능 저하로 이어질 수 있으나, 이러한 현상을 outcome supervision 방법론 자체의 한계로 보아야 할지는 분명하지 않다.

■ 저자들은 human feedback을 수집하는 높은 비용 때문에, human labelers을 사용하여 이러한 요인들을 쉽게 확인할 수 없어서, 대신 large-scale PRM을 사용하여 smaller models을 supervise함으로써 ablations을 수행하였다.

- 이 섹션의 나머지 부분에서는 섹션 3의 PRM을 PRM_large라고 지칭한다.

■ 이러한 설정은 적은 비용으로 대량의 데이터 수집을 시뮬레이션할 수 있게 해준다.

4.1 Process vs Outcome Supervision

■ outcome supervision과 process supervision의 직접적인 비교를 수행한다.

■ 먼저 small-scale generator에서 problem당 1개에서 200개 사이의 solutions을 샘플링한다.

■ 각 데이터셋에 대해 세 가지 형태의 supervision을 진행한다: process supervision from PRM_large, outcome supervision from PRM_large, outcome supervision from final-answer checking

■ 이 세 가지 reward models의 유일한 차이점은 supervision 방식의 선택뿐이며, 그 외에는 동일한 데이터셋으로 학습된다.

■ PRM_large가 outcome 및 process supervision에서 사용되는 방법은 다음과 같다.

- individual steps에 대한 labels은 PRM_large에서 출력되는 step-level probabilities을 기반으로 결정한다. 이를 위해 임의의 threshold 값을 설정한다: PRM_large가 20% 이상의 확률로 negative label을 할당하는 step은 incorrect한 것으로 간주한다.

- 이 threshold 값 20%는 PRM_large가 positive labels을 선호하는 방향으로, 약간 잘못 보정되어 있다는 실험 관찰을 기반으로 선택한 값이다.

- solution에 대한 process supervision을 위해, PRM_large에서 제공하는 step-level labels (positive or negative)을 첫 번째 negative로 표시된 step(첫 번째 틀린 step이 나타날 때)까지 반환한다. 이는 실제 사람의 데이터 수집 프로세스를 따라한 것(섹션 2.6 첫 번째 오류까지만 사용)이다.

- outcome supervision을 위해 PRM_large가 모든 step이 올바르다고 판단하는 경우에만 solution을 올바른 것으로 표시한다. (동일한 임곗값 로직 사용)

■ Fig 4a는 각 reward model을 best-of-500 selection 능력으로 평가한 결과이다. 모든 데이터 수집 규모에서 process supervision이 두 가지 형태의 outcome supervision보다 성능이 훨씬 뛰어나다는 것을 볼 수 있다.

■ Fig 4b는 각 시리즈의 best reward model을 다양한 N 값에 걸친 best-of-N 성능으로 평가한 결과이다. PRM_large를 사용한 outcome supervision이 final-answer checking 방식보다 조금 더 효과적인 것을 볼 수 있다.

■ 이러한 결과는 human이 아닌 PRM_large가 잘못된 reasoning을 사용하여 정답에 도달한 solutions에 대해 더 나은 supervision(즉, 이를 걸러냄)을 제공하는 것으로 볼 수 있다.

■ Fig 4의 결과를 통해 PRM_large에 의한 outcome supervision과 final-answer checking에 의한 supervision 중 어느 것이 더 확실히 적절한 outcome supervision baseline인지는 불분명하다.

■ final-answer supervision이 더 명시적으로 결과에 기반(단순히 final answer가 맞는지 틀린지만 체크)하고 있지만, 주요 약점인 false positives의 존재는 MATH dataset에서 다소 과장되었을 수 있기 때문이다.

- MATH dataset은 수학 문제로 구성되어 있기 때문에, 틀린 과정으로 우연히 맞는 답을 낼 확률이 비교적 높을 수 있다. 이는 false positive 문제를 과장되게 보여줄 수 있어, final-answer supervision의 단점이 부각될 수 있다.

■ 저자들은 Fig 4의 실험을 통해 PRM_large에 의한 outcome supervision을 더 좋게 평가했지만, false positive에 덜 민감한 도메인에서는 Fig 4와 결과가 다를 수 있기 때문에, 사용자들이 스스로 결론 내리기를 권장한다.

4.2 Active Learning

■ active learning의 영향을 다음과 같이 확인한다.

■ 데이터 선별을 위해, 각 problem당 하나의 샘플로 small-scale reward model인 PRM_selector를 학습시키고, 이 모델을 사용하여 problem당 1000개의 샘플에 점수를 매긴다.

■ 더 큰 reward models을 학습시키기 위해 problem당 N개의 샘플을 선택한다. 이때 80%는 PRM_selector가 판단하기에 가장 "convincing wrong-answer"한 samples로 구성하고, 나머지 20%는 남은 샘플 중 가장 "convincing"한 samples(right- or wrong-answer)로 구성한다. 선택된 샘플들을 PRM_large로 채점하고, 그 점수들을 사용하여 학습을 진행한다.

■ 이 과정은 모든 샘플이 PRM_selector 입장에서 비교적 설득력이 있고(PRM_selector가 낮은 점수를 준 샘플은 제외), 상당 부분이 적어도 하나의 오류를 포함하고 있음이 확실(80% convincing wrong-answe)하며, 전체 데이터셋이 wrong-answer solutions 쪽으로 지나치게 편향되지 않도록(20% right- or wrong-answer) 보장한다.

■ 이 데이터 라벨링 방식의 성능은 Fig 4a에 나와 있다.

■ 저자들은 active learning을 적용했을 때와 적용하지 않았을 때의 추세선 기울기를 비교하여, 이러한 active learning이 uniform data labelling보다 약 2.6배 더 데이터 효율적이라고 추정했다.

■ 그리고 저자들은 가장 큰 active learning dataset (200 samples per problem)으로 학습된 모델이 예상되는 추세선보다 성능이 약간 낮게 나타난다는 점에 대해, 200개의 샘플이 전체 선택 풀(1,000개)의 상당 부분을 차지하게 되면서, 상대적인 다양성 부족이 발생하여 active learning으로부터 얻을 수 있는 이점이 제한되었다고 주장한다.

■ 추가로, 데이터 수집 과정 내내 PRM_selector를 반복적으로 re-training하는 것이 미치는 영향을 확인했다. 이론적으로는 PRM_selector를 re-training하는 것이 유용해 보인다.

■ 각 iterations 사이사이에, 현재까지 라벨링된 모든 데이터를 사용하여 PRM_selector를 re-train시켰다.

■ 그러나 이 re-training 실험에서 원인을 알 수 없는 불안정성을 관찰했으며, 그 결과로 나온 reward models은 위에서 설명한 models보다 성능이 더 좋지 않았다고 한다.

5. OOD Generalization

■ out-of-distribution generalization을 측정하기 위해, large-scale ORM과 PRM을 가장 최신의 AP Physics, AP Calculus, AP Chemistry, AMC10, AMC12 exams에서 가져온 224개의 STEM 문제로 구성된 held-out set에서 평가한다.

■ 이 시험들은 pre-training dataset이 구축된 이후에 공개되었기 때문에, 모델이 이 문제들을 본 적 없다고 합리적으로 가정할 수 있다.

■ Table 1은 ORM, PRM 그리고 majority voting의 best-of-100 성능을 비교한 결과로, 섹션 3과 유사한 결과를 확인할 수 있다. PRM이 ORM과 majority voting 모두를 능가한다.

■ 이는 PRM이 적당한 수준의 분포 변화(distribution shift)를 견딜 수 있으며, 새로운 test questions에 대해서도 그 강력한 성능이 유지된다는 것을 보여주는 결과이다.

6. Discussion

6.1 Credit Assignment

■ process supervision의 한 가지 분명한 장점은 outcome supervision보다 더 정밀한 feedback을 제공한다는 것이다.

■ 결과에 기반하는 outcome supervision으로 학습된 reward model은 결국 어려운 credit-assignment 문제(성공/실패 원인이 어디에 기인하는지 정확히 찾아내는 문제)에 직면한다. 즉, 잘 일반화하기 위해서는 부정확한 solution이 "어디서 잘못되었는지"를 판단해야 한다.

■ 이는 hard problems에서 특히 더 어렵다: 대부분의 model-generated한 solutions은 어딘가에 오류를 포함하고 있으므로, outcome supervision으로부터 얻는 negative label의 marginal value는 낮다.

■ 대조적으로 process supervision은 더 풍부한 signal을 제공한다: 처음 몇 step이 실제로 정확했는지뿐만 아니라, 부정확한 step의 정확한 위치까지 명시하기 때문이다.

■ 그래서 process supervision은 credit assignment를 더 쉽게 만들며, 저자들은 process supervision의 강력한 성능이 이 점에서 기인한 것으로 추측한다.

6.2 Alignment Impact

■ process supervision은 AI alignment와 관련하여 outcome supervision과 비교했을 때 몇 가지 장점을 가진다.

■ process supervision은 모델이 인간이 선호하는 프로세스를 따르도록 유도하기 때문에, interpretable reasoning을 생성할 가능성이 더 높다.

■ 또한, process supervision은 본질적으로 더 안전하다: aligned된 behavior에 대한 대리 지표(proxy)로 모델 결과에 의존하기보다, aligned chain-of-thought에 직접 reward하기 때문이다.

■ 대조적으로, outcome supervision은 결과에 의존하기 때문에, 전달되는 preference가 덜 정밀하다. 이렇게 모델 결과라는 불완전한 proxy를 사용하는 것은 모델이 reward signal을 exploit하는 법을 학습(예: reward hacking)한 후 misaligned되는 결과를 초래할 수 있다.

- 최종 정답만을 reward signal로 사용한다고 하자. 최종 정답을 맞추는 경우에는 과정이 틀린 경우도 포함되어 있다. 즉, reward model을 학습시키기 이전에 이미 정답만 우연히 맞추는 꼼수가 들어가 있다.

- 그러므로 더 빠르게 reward hacking으로 이어질 수 있다고 생각된다.

■ 어떤 경우에는 AI system을 위한 safer한 방법으로 인해 성능 저하가 발생할 수 있다. 이러한 비용을 "alignment tax"라고 한다.

■ 논문의 결과는 process supervision이 사실상 음(-)의 alignment tax를 발생시킨다는 것을 보여준다. 단, 이러한 결과가 수학 도메인을 넘어 얼마나 광범위하게 일반화될지는 이 논문에서 알 수 없다.

6.3 Test Set Contamination

■ MATH dataset의 test set에는 여러 온라인 공간에서 논의된 문제들이 포함되어 있다. 그래서 해당 문제 중 일부가 pretraining dataset에 포함되었을 가능성이 높다.

■ 그래서 저자들은 string-matching heuristics을 사용하여 MathMix dataset에서 모든 MATH 문제를 제거하려고 시도했으나, 사람들이 이런 휴리스틱으로는 탐지하기 어려운 방식으로 문제를 바꿔서 게시할 수 있기 때문에, MathMix와 MATH dataset 간의 중복이 없다고 확실하게 보장을 하기는 어렵다.

■ 저자들은 model-generated solutions을 검사했을 때, 모델이 MATH의 문제들을 암기하고 있다는 징후는 포착하지 못했다고 한다. 그러나 이런 수동 검사를 빠져나가는 미묘한 형태의 암기를 배제하는 것은 불가능하며, 어느 정도의 data contamination이 MATH test set에서의 성능을 약간 부풀렸을 가능성은 여전히 존재한다고 언급한다.

■ 단, data contamination이 존재한다고 해도 PRM 방법뿐만 아니라 ORM 방법에서도 유사하게 나타날 것이기 때문에, PRM과 ORM의 비교 결과는 큰 영향을 받지 않을 것이라 예상한다.

■ 그리고 PRM이 generator 하에서 한 자릿수의 낮은 정답률을 보이는 MATH 문제들에 대해서도 correct solutions을 찾아내며(Appendix I), 이는 test set contamination을 통해 해당 문제들을 접하지 않았음을 나타내는 징후이다.

- 모델이 암기했다면 정답률이 높다. 그러나 어려운 문제에서는 매우 낮은 정답률을 보였고, PRM은 해당 문제들에 대해서도 정답을 찾아냈다. 이는 PRM의 결과가 암기가 아님을 시사한다.

■ 또한, 섹션 5의 일반화 결과는 test set contamination이 이 연구에 큰 영향을 미치지 않았다는 주장을 더욱 강화해 준다. 왜냐하면, uncontaminated가 보장된 문제들에서도 PRM이 우수하다는 결과를 관찰했기 때문이다.